O que é Ollama?

Ollama é um aplicativo gratuito e de código aberto que permite que empresas executem modelos de IA localmente em seu próprio hardware, em vez de usar serviços baseados em nuvem. Seu design amigável e ampla compatibilidade com diferentes sistemas de computador o tornaram incrivelmente popular, com sua base de usuários crescendo 46% em apenas três meses. Como um projeto relativamente novo, ele ganhou mais estrelas no GitHub do que PyTorch, um framework historicamente popular, e até superou Llama.cpp, a conhecida base de código de inferência LLM na qual é construído.

Alerta de Segurança: Vulnerabilidades no Ollama

Nossa equipe de pesquisa de segurança compilou informações sobre múltiplas vulnerabilidades críticas de segurança no framework Ollama de várias fontes. Essas vulnerabilidades variam em gravidade de moderada a alta, e algumas ainda estão presentes mesmo no patch mais recente. Todas as vulnerabilidades identificadas representam riscos comerciais significativos para organizações que implantam modelos de IA. Organizações que usam Ollama em ambientes de produção devem tomar medidas imediatas para avaliar sua exposição e implementar as salvaguardas apropriadas.

Entendendo as Vulnerabilidades em Detalhe

As vulnerabilidades que investigamos podem ser categorizadas em dois tipos principais, cada um com vetores de ataque distintos e possíveis impactos:

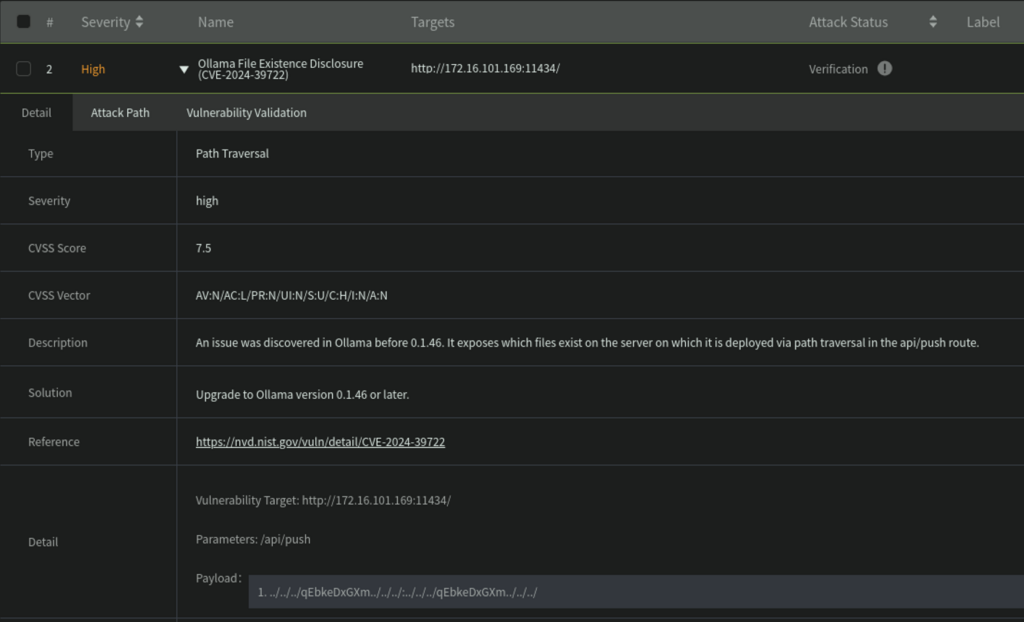

- Vulnerabilidades de Divulgação de Arquivos (CVE-2024-39722 e CVE-2024-39719): Essas falhas permitem que atacantes enumerem arquivos em seu servidor por meio das rotas API/Push e CreateModel do Ollama. Os atacantes podem mapear metodicamente a estrutura de diretórios do seu servidor sem autorização, permitindo ataques de acompanhamento mais direcionados ao revelar a configuração do seu sistema. Versões anteriores à 0.1.46 ainda são vulneráveis a esse padrão de ataque.

- Vulnerabilidades de Segurança em Modelos: O envenenamento de modelos ocorre quando atacantes introduzem modelos comprometidos em seu sistema ao baixar de fontes não confiáveis. Igualmente preocupante é o roubo de modelos, onde modelos proprietários podem ser exfiltrados para servidores externos sem autorização. Esses ataques expõem potencialmente propriedade intelectual e vantagens competitivas. Organizações que usam modelos personalizados ou ajustados enfrentam um risco particularmente alto, dado o impacto comercial potencial da perda de propriedade intelectual.

Essas vulnerabilidades são especialmente preocupantes dada a crescente adoção do Ollama em ambientes empresariais onde dados sensíveis e modelos proprietários podem ser processados.

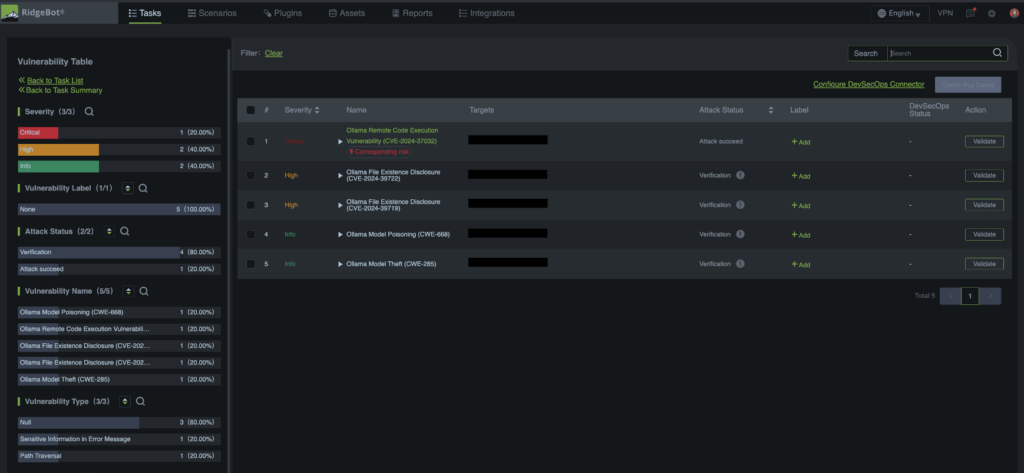

Detecção de Vulnerabilidades com RidgeBot

O RidgeBot da Ridge Security oferece testes automatizados alimentados por IA que podem identificar rapidamente essas vulnerabilidades em toda a sua infraestrutura de rede. Nossos módulos de varredura especializados detectam instalações do Ollama e determinam se elas são suscetíveis às vulnerabilidades identificadas sem interromper suas operações. Ao escanear em busca desses problemas, o RidgeBot adota uma abordagem não invasiva para verificar as vulnerabilidades com cargas úteis reais. Uma vez que as vulnerabilidades são descobertas, o RidgeBot fornece relatórios abrangentes, incluindo o tipo de vulnerabilidade, a gravidade, a descrição e os passos detalhados de remediação.

Fig 1: Vulnerabilidades do Ollama encontradas pelo RidgeBot

Fig 2: Relatório de Vulnerabilidades

Por que isso é importante

A segurança dos sistemas de IA está se tornando cada vez mais importante à medida que mais organizações adotam essa tecnologia. O rápido crescimento do Ollama demonstra o desejo das organizações de ter soluções de IA acessíveis, mas essa acessibilidade deve ser equilibrada com medidas de segurança adequadas.

Nossa equipe está comprometida em apoiar a identificação e remediação de vulnerabilidades em sistemas de IA para ajudar a proteger os ativos e dados valiosos da sua organização.